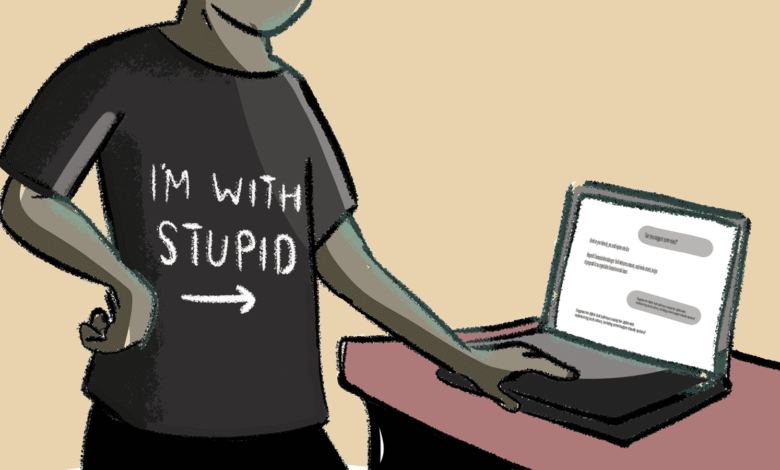

Čím více lidé používají AI, tím je pravděpodobnější, že přeceňují své vlastní schopnosti

Když jsme požádáni, abychom zhodnotili, jak dobří v něčem jsme, máme tendenci se tento odhad zcela mýlit. Je to univerzální lidská tendence, jejíž účinek je nejsilněji patrný u lidí s nižší úrovní schopností. Volal Dunning-Krugerův efektpo psychologech, kteří to poprvé studovali, tento fenomén znamená, že lidé, kteří nejsou v daném úkolu příliš dobří, jsou příliš sebevědomí, zatímco lidé s vysokou schopností mají tendenci své dovednosti podceňovat. Často to odhalí kognitivní testy — které obsahují problémy s hodnocením pozornosti, rozhodování, úsudku a jazyka.

Nyní však vědci z finské univerzity Aalto (spolu se spolupracovníky v Německu a Kanadě) zjistili, že pomocí umělá inteligence (AI) kromě toho odstraňuje Dunning-Krugerův efekt – ve skutečnosti jej téměř obrací.

Vzhledem k tomu, že se všichni stáváme více gramotnými v oblasti umělé inteligence díky šíření velkých jazykových modelů (LLM), vědci očekávali, že účastníci budou nejen lepší v interakci se systémy umělé inteligence, ale také lépe v posuzování jejich výkonnosti při jejich používání. „Namísto toho naše zjištění odhalují značnou neschopnost přesně vyhodnotit vlastní výkon, když používáme AI rovnoměrně v našem vzorku,“ Robin Welschpočítačový vědec z Aalto University, který je spoluautorem zprávy, uvedl v a prohlášení.

Zploštění křivky

Ve studii vědci zadali 500 subjektům logické uvažování Přijímací zkouška na právnickou fakultus polovičním povoleným používáním oblíbeného AI chatbota ChatGPT. Obě skupiny byly později testovány jak na jejich gramotnost v oblasti umělé inteligence, tak na to, jak dobře si myslely, že podávají výkon, a slíbili extra kompenzaci, pokud svůj vlastní výkon posoudí přesně.

Důvody za zjištěními jsou různé. Protože uživatelé umělé inteligence byli obvykle spokojeni se svou odpovědí pouze po jedné otázce nebo výzvě a přijali odpověď bez další kontroly nebo potvrzení, lze říci, že se zapojili do toho, co Welsch nazývá „kognitivní odlehčení“ – dotazování se na otázku s omezenou reflexí a přistupování k ní „mělčím“ způsobem.

Menší zapojení do našeho vlastního uvažování – nazývané „metakognitivní monitorování“ – znamená, že obcházíme obvyklé smyčky zpětné vazby kritického myšlení, což snižuje naši schopnost přesně měřit náš výkon.

Ještě více odhalující byla skutečnost, že všichni přeceňujeme své schopnosti při používání umělé inteligence, bez ohledu na naši inteligenci, přičemž propast mezi uživateli s vysokou a nízkou kvalifikací se zmenšuje. Studie to připsala skutečnosti, že LLM pomáhají do určité míry každému k lepšímu výkonu.

Ačkoli se na to výzkumníci přímo nezmínili, zjištění také přichází v době, kdy vědci ano dotazováním se začínáme ptát, zda běžné LLM nejsou příliš podlézavý. Tým Aalto varoval před několika potenciálními důsledky, jak se AI rozšíří.

Za prvé, metakognitivní přesnost celkově může trpět. Vzhledem k tomu, že se více spoléháme na výsledky, aniž bychom je přísně zpochybňovali, objevuje se kompromis, kdy se výkon uživatelů zlepšuje, ale klesá ocenění toho, jak dobře děláme úkoly. Bez přemýšlení o výsledcích, kontrole chyb nebo hlubším uvažování riskujeme, že oslabíme naši schopnost spolehlivě získávat informace, uvedli vědci ve studii.

A co víc, zploštění Dunning-Krugerova efektu bude znamenat, že všichni budeme i nadále při používání umělé inteligence přeceňovat své schopnosti, přičemž ti, kdo jsou z nás v oblasti umělé inteligence, to budou dělat ještě více – což povede ke zvýšené atmosféře nesprávného rozhodování a narušení dovedností.

Jednou z metod, kterou studie navrhuje, jak zastavit takový pokles, je nechat AI samotnou povzbudit uživatele k dalšímu dotazování, přičemž vývojáři přeorientují odpovědi tak, aby povzbudili reflexi – doslova klást otázky typu „Jak si věříte v tuto odpověď?“ nebo „co vám mohlo uniknout?“ nebo jinak podporovat další interakci prostřednictvím opatření, jako je skóre spolehlivosti.

Nový výzkum přidává další váhu rostoucímu přesvědčení, že jako Královská společnost nedávno argumentovalŠkolení AI by mělo zahrnovat kritické myšlení, nejen technické schopnosti. „Nabízíme návrhová doporučení pro interaktivní systémy umělé inteligence, abychom zlepšili metakognitivní monitorování tím, že uživatelům umožníme kriticky uvažovat o svém výkonu,“ uvedli vědci.