Jak je bezpečná AI ve zdravotnictví, závisí na lidech zdravotní péče

Vědci z IIT-Madras a Translational Health Science and Technology Institute ve Faridabad vyvíjejí uměle inteligentní (AI) model, který používá ultrasonografické obrázky předpovědět Věk rostoucího plodu. Volal Garbhini-Ga2, model byl vyškolen na skenování asi 3 500 těhotných žen, které navštívily civilní nemocnici Gurugramu v Haryaně. Každé skenování označilo různé části plodu, jeho velikosti a jeho hmotnost – opatření, která lze použít k předpovídání věku plodu.

Po tréninku to členové týmu testovali (neznačené) skenování z 1 500 těhotných žen, které navštívily stejnou nemocnici a kolem 1 000 těhotných žen, které navštívily křesťanskou lékařskou vysokou školu. Zjistili, že Garbhini-ga2 se dopustil chyby ve věku plodu jen půl dne. Toto je významné zlepšení oproti nejběžnější metodě dnes: použití Hadlockovy vzorce. Vzhledem k tomu, že vzorec je založen na údajích z kavkazských populací, bylo podle týmu IIT-Madras známo, že zmeškal věk plodu v Indii až o sedm dní.

Teď tým plány na testování jeho model v datových sadách z celé Indie.

To je jen pohled na to, jak nástroje AI tiše přetvářejí indickou zdravotní péči. Od fetálního ultrazvukového datování a pokynů s vysokým rizikem po virtuální pitevní a klinické chatboty odpovídají přesnosti expertů při zrychlení pracovních toků. Jejich slib však přichází proplétán se systémovými výzvami údajů a automatizační zkreslení, soukromí a slabé regulace, často zhoršené citlivostí samotného zdravotnického sektoru.

Užitečné, ale může se zlepšit

Téměř polovina všech těhotenství u indických žen je podle studie 2023 v Journal of Global Health. V HRPS je vysoká šance, že matka a novorozenci onemocní nebo umírají. Podmínky, které způsobují tyto výsledky zahrnout Těžká anémie, vysoký krevní tlak, preeklampsie a hypotyreóza. Rizika jsou vyšší u žen bez formálního vzdělání, rizika z venkovských oblastí a ty, které patří k marginalizovaným sociálním skupinám.

Odborníci tvrdí, že rutinní monitorování je nejlepším způsobem, jak snížit úmrtnost matek a perinatální v HRP. Ve venkovských oblastech je tento úkol často prováděn pomocnými sestra-midwives (ANM), zdravotními pracovníky, kteří jsou prvním kontaktním bodem mezi těhotnou ženou a lékařským systémem. ANM jsou vyškoleny zdravotnickými odborníky, aby rozpoznali HRP a poradili ženám o jejich možnostech.

Nevládní organizace Ngo Armman se sídlem v Bombaji zahájila takový vzdělávací program v roce 2021 ve spolupráci s UNICEF a vládami Telangana a Andhra Pradesh. Jedná se o školení zdravotnických pracovníků, včetně ANM, v „End-to-End Management of HRP“, řekl Armman’s Inovation Amrita Mahale.

Nevládní organizace trénuje ANM, aby sledovaly a spravovaly HRP prostřednictvím „školení ve třídě a digitálním učení,“ řekl Mahale a dodal, že ANM jsou také podporovány prostřednictvím linky pomoci WhatsApp „pro řešení pochybností a držení rukou, když procházejí učebním obsahem a aplikují jej na reálné vysoce rizikové případy těhotenství“.

V případě pochybností se ANM vyzývají, aby oslovili své trenéry s dotazy. „Samotní trenéři jsou však přepracovaní a ne vždy upřednostňují reakci na dotazy ANM,“ řekl Mahale. Společnost Armman tedy přijala AI chatbot začátkem tohoto roku. Uznává jak textové i hlasové dotazy od ANMS a reaguje ve stejném médiu s klinicky ověřenými odpověďmi.

Zdravotničtí odborníci nyní „působí jako lidé v smyčce, kteří vstoupí, když chatbot nemůže odpovědět na otázku, nebo pokud ANM není spokojen s odpovědí chatbota,“ řekl Mahale. Chatbot, který byl v současné době testován se 100 ANM, obdržel od svých uživatelů „94% pozitivní zpětnou vazbu“, řekl Mahale. „Odborník domény ohodnotil 91% odpovědí k datu jako přesné a uspokojivé.“

Označila však také problém: „Současná modely řeči (rozpoznávání) bojují s indickými jazyky, zejména regionálními variacemi a akcenty.“ To znamená, že chatbot může pochopit asi 5% procent dotazů, které jsou sdíleny spíše jako hlasové poznámky než jako text.

Nejlaskavější řez

Amar Jyoti Patowary vede Katedra forenzní medicíny na regionálním ústavu zdravotnictví a lékařských věd Indira Gandhi Indira Gandhi. Je jedním z mála indických odborníků na „virtuální pitevní“.

Pitvy nemají dobrou veřejnou pověst. Když se Dr. Patowary a jeho tým zeptali příbuzných 179 zesnulých lidí, kteří podstoupili pitvu na oddělení, Asi 63% Vyjadřovaly obavy z zmrzačení těla a zpoždění při provádění pohřebních obřadů. Podobné problémy byly hlášeno také z venkovské Haryany.

Ve virtuální pitvě nebo virtopsii je tělo naskenováno pomocí strojů CT a MRI, aby se generovaly podrobné obrázky jejích vnitřních struktur. Poté počítač vytvoří 3D obrázek těla. Lékaři přivádějí tento obrázek do konvolučních neuronových sítí (CNNS)-modely hlubokého učení zběsily při extrakci vlastností z jedné sady obrázků a jejich použití k klasifikaci obrázků v jiných.

V roce 2023 vědci z Tohoku University v Japonsku postavený CNN, která dokázala rozlišit jednotlivce, kteří zemřeli na utopení od těch, kteří zemřeli na jiné příčiny pomocí skenování hrudníku CT. Model byl 81% přesný „pro případy, kdy byla provedena resuscitace, a 92% pro případy, kdy se o resuscitaci nepokusila,“ napsali autoři ve svém příspěvku. V roce 2024 švýcarští vědci rozvinutý CNN, která by mohla říci, zda osoba zemřela na mozkové krvácení založené na postmortem CT obrázcích.

Zatímco konvenční pitva trvá asi 2,5 hodiny, může být virtopsie dokončena asi za půl hodiny, řekl Dr. Patowary.

V konvenčních pitvách, jakmile je tělo pitvá, může být vyžadována druhá disekce, pokud byla první neprůkazná. To je těžší. Virtopsie však umožňují tolik disekcí, kolik je požadováno, protože skenování lze použít k znovu a znovu rekonstrukci těla.

To, co by si mohlo chybět, jsou však „malá zranění v měkké tkáni“ a změny v barvě tkání a orgánů a jak vůně těla a jeho tekutin, což by mohlo naznačovat, jak člověk zemřel, Dr. Patowary varoval. Přesto také vyjádřil jistotu, že kombinací virtopsie s „verbální pitvou“ – kontrola s doprovodným relativním nebo policistou pro klinicky relevantní detaily – a vizuálním vyšetřením těla a jeho dutinám lze tyto výzvy překonat.

Řízení přístupu

Tyto případy naznačují, že nejlepší využití AI může být asistentem zdravotnického profesionála. V roce 2019, Medibuddy, digitální zdravotnická společnost, která poskytuje online konzultace do lékaře a další služby, experimentovala s AI botem, který by mohl chatovat s pacientem, extrahovat klinicky relevantní detaily z konverzace, kompilovat a prezentovat je lékaři spolu s navrhovanými diagnózami. Devět z 15 lékařů, kteří tuto aplikaci testovali, uvedlo, že je to užitečné, zatímco zbytek zůstal „skeptický“, řekl Krishna Chaitanya Chavati, hlava údajů Medibuddy.

Jako klíčový problém označil soukromí dat. V Indii se digitální osobní údaje, včetně zdravotnických informací jednotlivce, řídí zákonem o informačních technologiích z roku 2000 a zákonem o ochraně osobních údajů 2023. A zákon se konkrétně zmiňuje technologie AI, ačkoli právníci naznačují, že se mohou vztahovat na nástroje AI. Dokonce i tehdy „zákon DPDP postrádá jasnost rozhodování a odpovědnosti založené na AI,“ napsali právníci v a Květen 2025 Recenze.

Pro zmírnění těchto obav Chavati řekl, že jsou nutné silné protokoly zabezpečení dat. Ve společnosti Medibuddy tým nasadil několik, z nichž dva jsou osobní identifikovatelný informační maskovací motor a přístup založený na rolích. Maskovací motor je program, který identifikuje a skrývá všechny osobní údaje z konkrétních algoritmů, což brání neoprávněným uživatelům v sledování dat na jediného jednotlivce. Přístup založený na rolích zajišťuje, že nikdo v rámci společnosti nemá přístup ke všem datům jednotlivce, pouze části relevantní pro jejich práci.

Ve smyčce

Shivangi Rai, právník, který pomáhal navrhnout Národní zákon o veřejném zdraví a Zabezpečení digitálních informací v zákoně o zdravotní péčiŘekla „automatizační zkreslení“ je také další příčinou obav. Rai je v současné době zástupcem koordinátora Centra pro vlastní kapitál, právo a politiku v Pune.

Automatizační zkreslení je „tendence k příliš důvěry a dodržování návrhů automatizovaného systému, i když jsou návrhy nesprávné,“ řekl Rai. K tomu dochází, když „člověk ve smyčce“, jako je lékař, příliš bankuje úsudek aplikace poháněné AI „spíše než jejich vlastní klinický úsudek“.

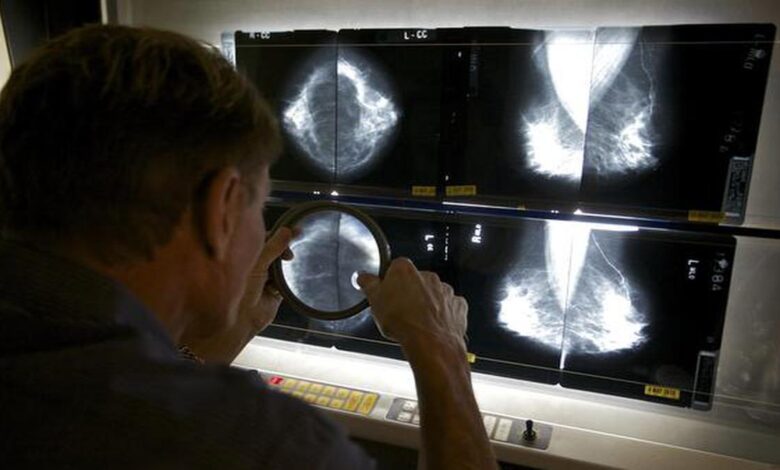

V roce 2023 vědci z Německa a Nizozemska zeptal se Radiologové s různými stupni zkušeností k vyhodnocení mamogramů (rentgenové skenování prsou) a přiřazení skóre BI-RADS. Bi-RADS je standardizovaný metrický radiologové používají k hlášení malignity rakovinné tkáně pozorované v mamogramech.

Radiologům bylo řečeno, že model AI bude také analyzovat mamogram a přiřadit skóre BI-RADS. Ve skutečnosti vědci neměli takový model; Libovolně a tajně přidělili skóre některým mamogramům. Vědci zjistili, že když „model AI“ vykázal nesprávné skóre, vlastní přesnost radiologů drasticky klesla. Dokonce i ti, kteří mají více než desetiletí zkušeností, hlásili správné skóre BI-RADS v pouhých 45,5% takových případů.

Vědci uvedli, že jsou překvapeni, že „i vysoce zkušení radiologové byli nepříznivě ovlivněni úsudky systému AI,“ uvedl hlavní autor studie v roce 2023.

Pro RAI je tato studie důkazem naléhavé potřeby trénovat „lékaře na hranici AI“ a neustále testovat a přehodnotit „nástroje AI vyvíjené pro a používané ve zdravotnictví“.

Indické rychlé přijetí lékařské umělé inteligence osvětlilo cestu k levnější, rychlejší a spravedlivější péči. Algoritmy však zdědí lidskou omylnost a zároveň ji také zabývají. Má -li technologie rozšířit a ne nahradit etickou medicínu, bude lékařská AI potřebovat robustní správu dat, školení lékaře a vynutitelnou odpovědnost.

Sayantan Datta je členem fakulty na Krea University a nezávislým vědeckým novinářem.

Publikováno – 12. června 2025 05:30