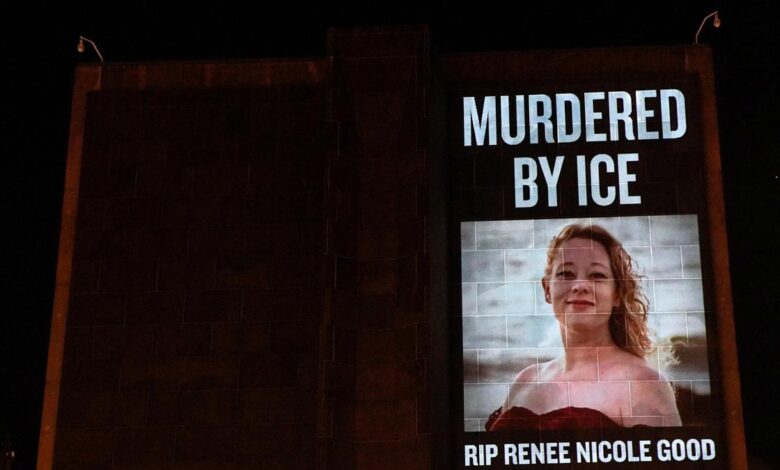

Po střelbě na ICE v Minneapolis zaplavily sociální média výmysly umělé inteligence o oběti a střelci

Několik hodin po smrtelné střelbě v Minneapolis imigračním agentem zaplavily online platformy AI deepfakes oběti a střelce, což podtrhlo rostoucí prevalenci čemu odborníci říkají „halucinovaný“ obsah po hlavních zpravodajských událostech.

Oběť středeční střelby, identifikovaná jako 37letá Renee Nicole Goodová, byla zasažena z bezprostřední blízkosti, když se zjevně snažila ujet maskovaným agentům, kteří se tísnili kolem jejího SUV Honda.

AFP našla desítky příspěvků napříč platformami sociálních médií, především X vlastněnou Elonem Muskem, ve kterých uživatelé sdíleli obrázky vytvořené umělou inteligencí, které měly „odmaskovat“ agenta z agentury Immigration and Customs Enforcement (ICE).

„Potřebujeme jeho jméno,“ napsal Claude Taylor, který stojí v čele protitrumpovského politického akčního výboru Mad Dog, v příspěvku na X s obrázky AI. Příspěvek zaznamenal více než 1,3 milionu zobrazení.

Taylor později tvrdil, že příspěvek smazal poté, co se „dozvěděl, že je to umělá inteligence“, ale stále byl viditelný pro online uživatele.

Autentický záznam natáčení, který přehrálo několik médií, nezachycuje žádného z agentů ICE se staženými maskami.

Mnoho výmyslů bylo vytvořeno pomocí Grok, nástroje AI vyvinutého startupem xAI Elona Muska, která čelila silné kritice kvůli nové funkci „úpravy“, která rozpoutala vlnu sexuálně explicitních snímků.

Někteří uživatelé X použili Grok k digitálnímu svlékání staré fotografie Good, která se usmívá, a také nové fotografie jejího těla, která se po natáčení sesula, a vygenerovala snímky AI, které ji ukazují v bikinách.

Podobné manipulaci byla vystavena i další žena nesprávně označená jako oběť.

Další uživatel X zveřejnil obrázek maskovaného důstojníka a vyzval chatbota: „Hej @grok sundej tomuto člověku obličejovou masku.“ Grok okamžitě vytvořil hyperrealistický obraz muže bez masky.

Od X nepřišel žádný bezprostřední komentář. Když jej AFP oslovila, xAI odpovědělo stručnou, automatickou odpovědí: „Legacy Media Lies.“

Virální výmysly ilustrují novou digitální realitu, ve které samozvaní internetoví detektivové používají široce dostupné generativní nástroje umělé inteligence k vytváření hyperrealistických vizuálů a poté je zesilují napříč platformami sociálních médií, které do značné míry omezily moderování obsahu.

„Vzhledem k dostupnosti pokročilých nástrojů umělé inteligence je nyní standardní praxí, že herci na internetu ‚přidávají do příběhu‘ nejnovější zprávy způsoby, které neodpovídají tomu, co se ve skutečnosti děje, často politicky stranickým způsobem,“ řekl agentuře AFP Walter Scheirer z University of Notre Dame.

„Novým vývojem bylo použití umělé inteligence k ‚vyplnění prázdných míst‘ v příběhu, například použití umělé inteligence k ‚odhalení‘ tváře důstojníka ICE. To je halucinovaná informace.“

Nástroje umělé inteligence se také stále častěji používají k „dehumanizaci obětí“ v důsledku krizové události, řekl Scheirer.

Jeden obrázek umělé inteligence znázorňoval ženu, která byla mylně považována za Dobrou, jako vodní fontánu s vodou vytékající z otvoru na krku.

Další ji zobrazoval, jak leží na silnici s krkem pod kolenem maskovaného agenta scéna připomínající v roce 2020 policejní vraždu černocha jménem George Floyd v Minneapolis, což vyvolalo celonárodní protesty proti rasové spravedlnosti.

Výmysly umělé inteligence, často zesílené partyzánskými herci, podnítily alternativní realitu kolem nedávných zpravodajských událostí, včetně amerického zajetí venezuelského vůdce Nicolase Madura a loňské vraždy konzervativního aktivisty Charlieho Kirka.

Deformace umělé inteligence jsou „problematické“ a přispívají k „rostoucímu znečištění našeho informačního ekosystému,“ řekl agentuře AFP Hany Farid, spoluzakladatel GetReal Security a profesor na University of California v Berkeley.

„Obávám se, že toto je naše nová realita,“ dodal.

Publikováno – 9. ledna 2026 09:37 IST